애플 세계 개발자 컨퍼런스인 Apple WWDC 2023에서 새로운 세대의 Mac과 OS, 그리고 가장 이슈였던 애플의 증강 현실 제품이 공개되었습니다. 오프닝에 등장한 팀쿡이 ‘역대 최대의 소식을 발표한다’며 그 기대감을 다시 한번 자극하기도 했습니다.

이번 글에서는 Apple WWDC 2023의 가장 핵심이라고 할 수 있는 ‘Apple Vision Pro’에 대해 자세히 알아보도록 하겠습니다. 그 전에 행사에서 공개된 다른 제품과 개선 사항을 포함한 요약본을 공유드립니다.

Apple WWDC 2023 Summary

Macbook Air 15’’ 공개: M2칩 탑재, 15.3인치, 11.5mm 두께, 무게 1.5Kg, 18시간 배터리, 맥세이프 충전, 썬더볼트 2개, 이어폰 단자, 4가지 색상, 1080 카메라, 3개 마이크, 6개 스피커, 공간음향

프로 시리즈 제품 2가지 공개: Mac Studio(M2 Max 탑재), Mac Pro(M2 Ultra 신규 칩 탑재)

M2 Ultra 칩: M2 Max 2개 연결, 24코어 Cpu, 192GB 메모리

→ 아이폰, 아이패드, 맥 시리즈 모두 애플 실리콘으로의 전환 완성

OS: iOS17 공개, Air Drop 근거리 버전인 Name Drop, Standby UI, Mac Os Sonoma 공개 등

Apple Vision Pro: 새로 공개한 공간 컴퓨팅 디바이스, vision OS 기반, Optic ID (홍체인식 보안), 3499달러, 내년 초 공개 예정

① Apple Vision Pro 개요

애플이 공개한 Apple Vision Pro의 몇 가지 주요 특징을 알아보도록 하겠습니다.

주요 특징

디바이스를 착용하자마자 현실 세계의 주변 사물이 시야에 들어오고 홈 화면이 보이는 3D 인터페이스

별도의 컨트롤러 없이 오로지 눈동자 + 손동작 + 목소리로 제어 가능

사용자 주변에 사람이 있는 경우 디스플레이에 눈을 보여주는 EyeSight 기능으로 디지털과 현실의 자연스러운 연결

주변 환경을 어둡게 하거나 가상 풍경으로 설정하는 등 몰입도 조정 가능

공간 사진과 공간 동영상 촬영 가능

Mac이 개인용 컴퓨팅이고 iPhone이 모바일 컴퓨팅의 디바이스였다면,

Apple Vision Pro는 ‘공간 컴퓨팅(Spatial Computing)’을 구체화

② Apple Vision Pro의 기술

증강 현실을 구현할 때는 현실 세계의 정보를 받아들이는 동시에 그 위에 애플리케이션을 구동하기 위한 높은 컴퓨팅 성능과 실제 감각과 유사한 수준의 시청각 자극이 필수입니다. 애플은 컴퓨팅, 디스플레이, 오디오 성능을 향상시키는 동시에 냉각, 소음으로 인한 사용자 경험을 해치지 않기 위해 노력한 것으로 보입니다.

컴퓨팅

탑재된 Apple M2이 전반적인 컴퓨팅 성능을 담당하고, R1 칩이 실시간 센서 정보 처리를 담당함.

전용 R1 칩을 통해 12개의 카메라, 5개의 센서, 6개의 마이크 실시간 정보를 처리. → 눈보다 8배 빠른 12밀리 초마다 새로운 이미지를 제공하여 지연 현상 감소로 멀미 현상 해결

디스플레이

Micro OLED를 탑재하여 실제 인간의 시력과 같은 수준의 해상도와 색 충실도를 구현함.

아이폰 픽셀 1개가 들어갈 공간에 64개의 픽셀을 집어 넣어서 양쪽 2개 패널에 총 2천3백만 픽셀로 사람 눈에 픽셀이 보이지 않음.

4K 해상도로 동영상을 렌더링 하고, 어느 각도에서 봐도 선명한 글씨를 볼 수 있음.

특수 3겹 렌즈를 통해 입체감과 선명감을 구현함.

EyeSight

Vision Pro를 착용 중에도 주변 사람과 상호작용하기 위한 방안

곡면 OLED 패널과 렌티큘러 렌즈를 사용해서 실시간으로 사용자 눈의 모습을 보는 사람의 시점에 맞게 기기에 표시해 줌 → 마치 기기가 투명한 것처럼 보이게 해주는 3D 디스플레이 기술

오디오

현실 세계의 소리와 적절히 연동하고, 오디오팟을 통해 공간 음향을 구현함.

Audio Raytracing 기술을 통해 주변에 위치한 물건의 질감과 특징을 파악함.

머신 러닝

Facetime 등 사용자의 얼굴을 보여줘야 할 때 눈만 보여주는 것이 아니라 사용자의 실물을 닮은 모습을 재현해 냄.

사용자를 바라보는 카메라가 없더라도 전면 센서를 활용해 사용자의 얼굴을 스캔 후 사용자의 디지털 페르소나를 생성함. 사용자의 표정과 손 움직임에 실시간으로 반응함.

③ vision OS 운영체제

Core OS: macOS, iOS, iPadOS 등 집합체 기반

macOS, iOS, iPadOS를 기반으로 했기 때문에 기존 앱을 Vision Pro 플랫폼에서 연동할 수 있다는 점에서 영리한 생태계 전략임.

Real-Time Subsystem: 성능 중심의 작업 처리

Foveated Renderer: 실시간 눈의 위치를 반영하는 초점 렌더링 파이프라인으로 시선이 머무는 부분의 화질을 최고의 퀄리티로 유지

Multi-App 3D Engine: 동일한 시뮬레이션상에서 서로 다른 앱들을 동시에 구동

Spatial Frameworks: 기존의 앱 프레임워크를 확장하여 공간 경험 지원

④ Vision Pro의 새로운 생태계

Vision Pro가 PC, 모바일을 넘어 ‘공간’이라는 차원에서의 경험을 제공한다는 점에서 새로운 플랫폼으로서 생태계를 형성해나갈 가능성이 높습니다. 실제로 이미 애플은 Vision Pro 내부에 들어갈 앱 스토어를 공개했고, 내년 판매 전까지 개발자 커뮤니티에서 다양한 애플리케이션을 개발하길 기대한다고 밝히기도 했습니다. 이 생태계에는 기존의 앱과 새로운 앱이 공존할 것으로 예상됩니다.

기존 앱 호환

vision OS의 기반이 iOS, iPadOS인만큼 기존 앱들의 호환이 가능하다고 하며, 개발자들이 사용하고 있는 Xcode, SwiftUI, RealityKit, ARKit 등을 활용해 앱 개발을 할 수 있다고 합니다. 특히, Microsoft 365의 생산성 앱뿐만 아니라 Zoom, Webex, Teams 등 화상 회의 앱을 통해 업무용으로도 사용 가능성을 제시했습니다. 또한, Unity와의 협력을 통해 Unity 엔진 기반의 게임과 애플리케이션도 Vision Pro에서 사용할 수 있다고 합니다.

새로운 앱 등장

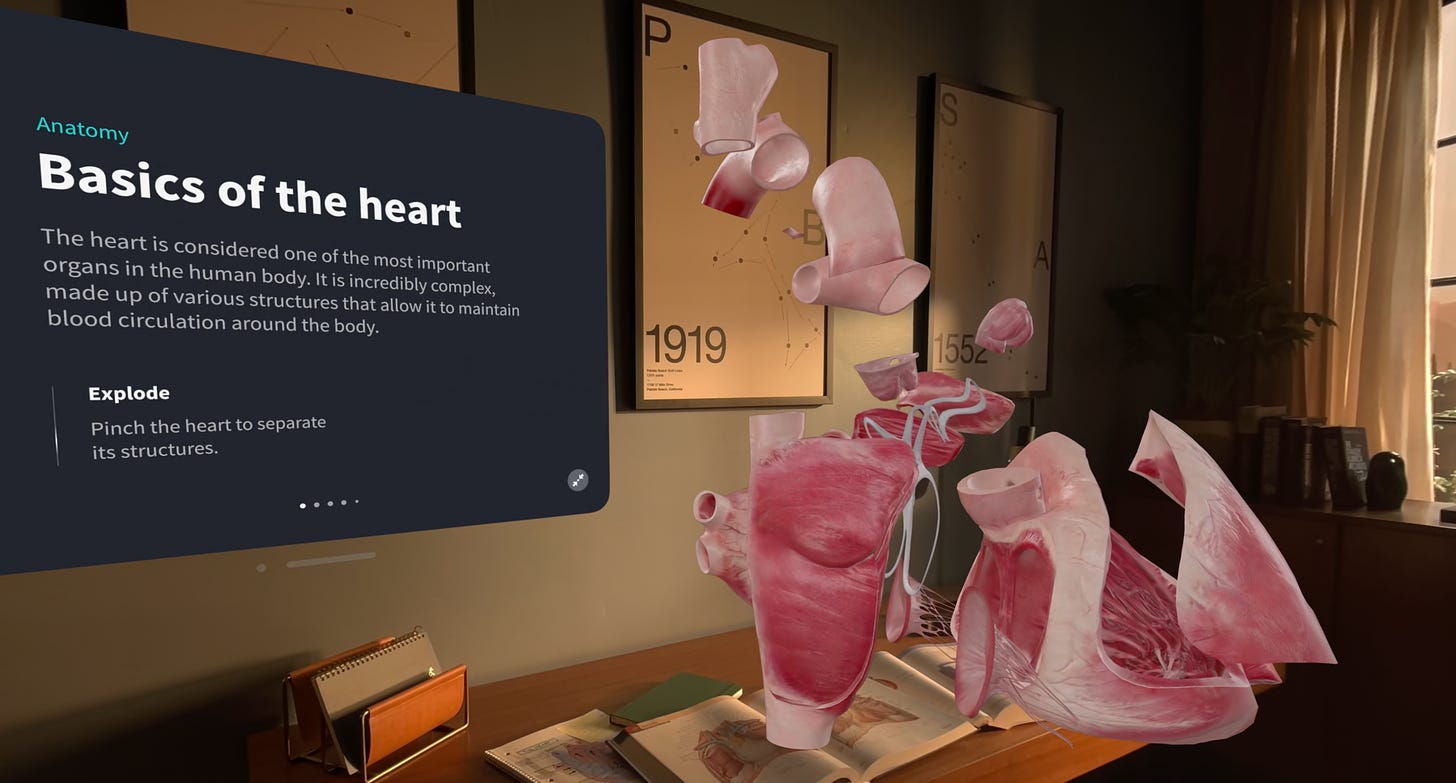

이번 공개 전 애플은 일부 개발자와의 협업으로 3D 인체 모형, 자동차 디자인, 제품 생산 라인, 디제잉 등의 용도로 사용할 수 있는 새로운 애플리케이션을 개발했다고 합니다. 공통적으로 ‘공간’이라는 차원을 활용하여 기존과 차별화된 사용자 경험을 제공할 수 있는 프로그램 입니다. 또한, 애플이 전용 공간 앱을 개발할 수 있는 Reality Composer Pro 공개한 점은 새로운 개발자 생태계를 만들기 위한 시도로 해석됩니다.

VR/AR 시장의 80% 가량을 메타가 독점하는 상황에서 애플은 생태계 전략을 활용하여 시장 점유율을 높일 것으로 보임. 특히, 새로운 개발 언어나 플랫폼만을 고집하지 않고 기존의 개발 언어와 OS를 연동했다는 점에서 진입 장벽을 최대한 낮추었음. 앞으로 애플이 어떠한 방식으로 유연성과 개방성을 보일지 주목해볼만 함.

⑤ Vision Pro와 개인 정보 보호

항상 그러하듯 애플은 이번에도 개인 정보 보호를 강조했습니다. Vision Pro 디바이스 센서를 통해 사용자의 시선이 수집될 수 있다는 우려를 종식시키기 위한 개인 정보 보호 정책과 새로운 잠금 해제 방식인 Optic ID를 소개했습니다.

개인 정보 보호 정책

사용자의 시선은 사적 정보로서 안구 입력 정보는 별도의 레이어로 격리되며, 손가락 사용 시 위치 값만 애플리케이션에 전달됨.

개별 애플리케이션은 주변 정보를 필요로하지 않으므로 사적인 공간에 대한 개인 정보 보호가 가능함.

Optic ID

홍체 인식을 통한 사용자 인식 방식으로 Optic ID 데이터는 암호화되고 기기 안에만 저장됨.

Apple Pay와 연동되어 앱스토어 구매와 비밀번호 자동 완성에 사용됨.

애플 vs. 메타

몇 년 전 메타버스 열풍이 불었을 때부터 기대가 많았던 애플이었는데요. 이번 공개를 계기로 애플과 메타의 메타버스 경쟁이 더욱 치열해지 않을까 싶습니다. 그런 의미에서 향후 메타버스 시장을 바라볼 수 있는 관점은 두 가지 정도가 있을 것 같습니다.

[1] 컴퓨팅 - 공간 디바이스 - 인공지능 기술 간의 상호작용

애플과 메타 모두 컴퓨팅 하드웨어, 디바이스, 인공지능 영역에서 나름 선두 기업인만큼 기술 간의 상호작용을 통해 어떻게 시너지를 내는지 살펴볼 필요가 있겠습니다.

[2] 애플과 메타의 생태계 전략에 따른 파트너십 영역 다툼

이번 발표에서 애플은 플랫폼으로서 포지셔닝을 했고 디즈니와 유니티와의 협업을 통해 생태계를 구성했다고 밝힌 바 있습니다. 메타가 작년 10월 마이크로소프트와 협업하여 오큘러스 퀘스트에 탑재한 것과 비슷한 전략으로 해석되는데요. 두 기업이 다른 기업과 어떻게 파트너십을 맺으며 생태계를 구성해나가는지 지켜보면 좋겠습니다.

지금까지 애플 WWDC 2023에서 공개된 Vision Pro에 대해 살펴보았습니다.

설레네요 ㅎㅎ